O monitoramento de mídias sociais, como é oferecido há cerca de 10 anos por agências digitais, consultorias e afins, se baseia em algumas premissas importantes da comunicação digital. Em primeiro lugar, temos a noção de influência potencial dos conteúdos publicados online. O esquema proposto por Philip Sheldrake abaixo é de eloquente simplicidade:

Com o lançamento e popularização das ferramentas plenas de monitoramento (aquelas que permitem coleta, armazenamento, análise de sentimento, classificação, geração de relatórios) a partir de 2006/2007 na América do Norte e Europa (como Sysomos, Brandwatch, Radian6) e 2009/2010 no Brasil (como Scup, Seekr, Brandcare), o monitoramento de mídias sociais se consolidou como serviço e prática dentro de agências de publicidade e afins. As práticas foram desenvolvidas de forma relativamente alheia a padrões, teorias, conhecimentos e práxis a pesquisa de mercado.

Em parte por causa disto, na maior parte das ferramentas mais generalistas – com exceção de ferramentas especializadas ou as mais relevantes do mercado -, é possível perceber relativa estagnação das possibilidades oferecidas. Há três lacunas que são especialmente relevantes neste sentido devido ao potencial de inteligência, que tornam-se especialmente graves ao se pensar o quanto o volume de dados disponíveis hoje é imensamente superior ao volume que pioneiros de algumas metodologias tinham acesso.

Foco nos Emissores / Monitoramento de Usuários

Os dados na maioria das ferramentas são baseadas nas chamadas menções ou ocorrências. É a contagem de unidades de conteúdo (tweets, posts, comentários, vídeos, fotos) coletadas, base para as comparações e medições realizadas quanto a volume, sentimento, temáticas, respostas etc. Mas existe uma grande discrepância, muitas vezes bem mais intensa do que uma distribuição de Pareto, pois a minoria dos usuários publica a maioria das ocorrências.

Ocorrências x Usuários. Assim, um dos padrões do mercado, o reporte dos dados de acordo com o número de ocorrências/menções, é questionável em boa parte das entregas realizadas. Poder entregar os dados a partir da quantificação dos usuários, assim como comparar a variação e concentração do engajamento, traz maior confiabilidade às conclusões.

Desenhos amostrais. As amostras de dados nas ferramentas de monitoramento de mídias sociais em sua maioria são baseadas nas ocorrências, ao invés dos usuários em si. Ainda existe muito chão metodológico a se percorrer no sentido de confiabilidade e representabilidade de amostras feitas a partir de coletas do tipo, mas a depender do objetivo, tomar os usuários como base (ao invés das menções) diminui muito imprecisão dos dados.

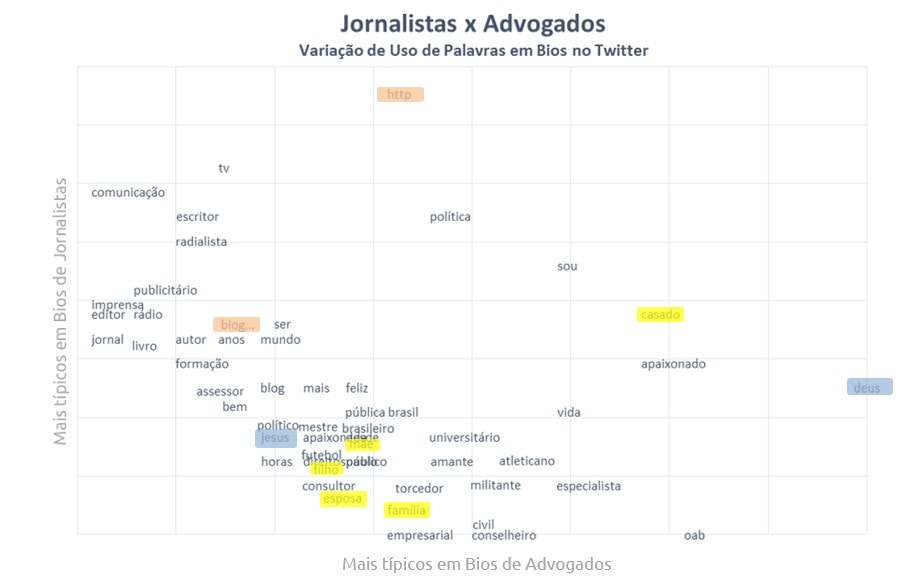

Estudos focados nos usuários. Parâmetros de busca que coletam todas as menções de usuários em mídias como Twitter, Instagram, Blogs ou Grupos de Facebook abrem o leque de produtos informacionais. Profissionais mais inventivos utilizam estes recursos para desenvolver Estudos de Público, Ideação de Personas, Construção de Segmentos e afins. Porém, as opções de tagging, filtragem e extração dos dados focados nos usuários ainda são relativamente incomuns mesmo em líderes de mercado. Algo tão simples como permitir a codificação dos usuários e decorrente geração de relatórios a partir destes códigos abre imensamente o leque de entregas (e, por tabela, monetização).

Técnicas de Linguística de Corpus e Text Analytics

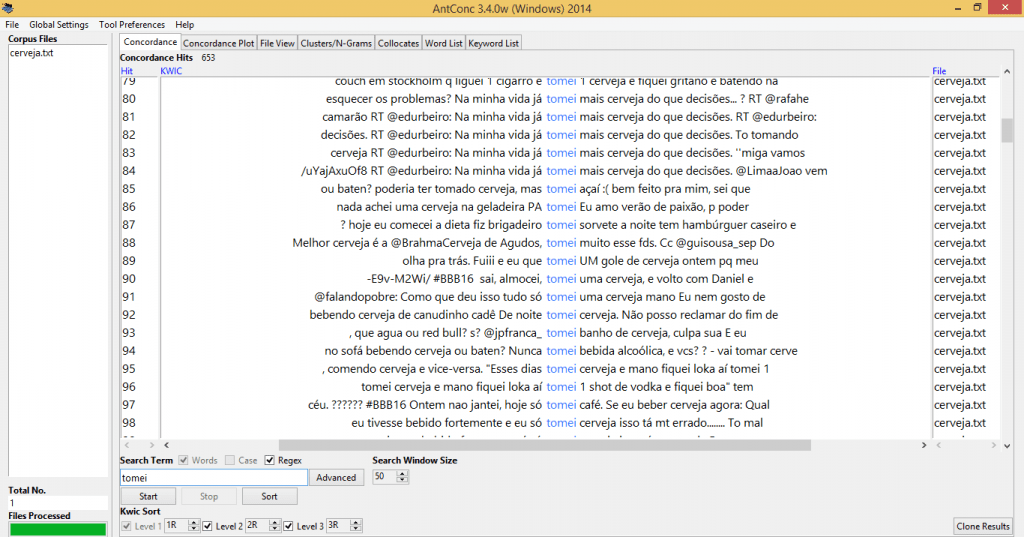

As técnicas de text analytics ainda são muito arcaicas nas ferramentas, de modo geral. Na maioria absoluta, a contagem de frequência de palavras se baseia apenas em 1-gram, stop words não são editáveis, não há lemmatização e outros recursos que envolvam associação entre as palavras são inexistes. Algumas buscam desenvolver processamento natural de linguagem natural em busca da malfadada análise de sentimento automática, deixando de lado o resto da riqueza dos textos.

Revisando uma simples definição de linguística de corpus por Tom McEnery, é transparente o potencial de relação entre as áreas: “Linguística de Corpus é o estudo da linguagem em larga escala com análise apoiada por computador de coleções extensas de falas ou textos escritos“.

Ao se olhar para o histórico da linguística de corpus, por exemplo, a comparação de volume de dados disponíveis é monumental. A disciplina tem como um dos seus principais marcos a criação do Brown Corpus nos anos 1960. Pesquisadores da Brown University compilaram, à época, 500 textos representativos do inglês americano, com 2000 palavras cada, totalizando 1 milhão de palavras.

Na comparação com qualquer projeto de médio / grande porte de monitoramento, o volume bruto de dados é facilmente superado. Mesmo o HERMES, corpus de 7 milhões de tweets desenvolvido por Michelle Zappavigna para seu livro de 2012, parece pequeno frente à dimensão de projetos comuns de grandes empresas que realizam monitoramento de mídias sociais.

A rigor, não há representatividade e construção rigorosa dos corpora nestes casos, mas porque tais volumes de dados textuais não são explorados com técnicas herdadas da linguística de corpus? Não é como se as tecnologias estivessem fora do alcance dos desenvolvedores, uma vez que softwares avançados como Voyant Tools e Antconc são disponibilizados de forma aberta e gratuita.

Análise de Redes Sociais

Talvez o mais chocante em um mercado que trata seus profissionais por “analistas de redes sociais” é a rara utilização, pasmem, de conceitos da análise de redes sociais em si. Termos como nodes, laços, grafos e clusters são raros no léxico de uma área que ainda ignora décadas e décadas de pensamento sobre as dinâmicas das redes.

As duas imagens abaixo exemplificam bem a questão da escala quando falamos das redes nas mídias sociais. A primeira é uma adaptação de clássico estudo realizado por Jacob Moreno em uma escola feminina, analisando dinâmicas de sociabilidade de estudantes na década de 1960. São 26 estudantes e 52 conexões que representam a desigualdade de afeto e atenção social:

A próxima é a visualização dos dados do pequeno estudo que fizemos sobre a mobilização #PrimeiroAssédio. São dezenas de milhares de tweets coletados em questão de horas, resultando em uma rede navegável que faz emergir padrões de interação, influência, conflito e colaboração na rede. Um sonho quase inimaginável para os pioneiros da ARS décadas atrás.

A rigor, as conexões entre perfis ou hashtags já estão ali implícitas em qualquer monitoramento realizado, nos padrões de tweets e imagens publicadas. Mas enquanto a tecnologia só olha para a coleta de dados, deixando de lado a inovação proativa, estas conexões não são aproveitadas – não se transformam em valor nem intelectual nem financeiro. Como vimos no outro post sobre Ferramentas de Análise de Redes para Mídias Sociais, ainda são raras as ferramentas comerciais com funcionalidades de redes, dificultando o trabalho dos profissionais especializados. E não é por falta de oportunidade e demanda: o mercado está ávido por um lado, e educadores fazem esforços intensos para transformar a alfabetização em redes em algo universal.

Conheça a formação completa em análise de mídias sociais, que agrega os cursos online de Análise de Redes, Monitoramento e Inteligência e Etnografia em Mídias Sociais. Estes cursos são liderados por professores com formação sólida tanto no ambiente acadêmico quanto mercadológico, com passagens por grandes agências e empresas referências na área. Assista abaixo o vídeo sobre curso de Análise de Redes: